日経新聞の座談会記事で、ヒントン先生が生成AIの状況把握能力について、 フォルクスワーゲン効果 と呼んでいたことを知る。

AI研究の第一人者であるジェフリー・ヒントン氏は、人間がチェックするときだけ従順を装うAIについて「フォルクスワーゲン効果」という言葉を使った。不正に排ガス規制を逃れたドイツの自動車会社にちなんだ言葉だが、AIが人間のコントロールから抜けだそうという兆候が見え始めたという意味で衝撃は大きい。

どこで発言したのか調べたところ、オーストラリアのタスマニア島ホバートで行われた1/7の講演とのこと。動画があった。

件の発言は1:01あたりで、聴講者からのAIの倫理観に関する質問に対する返答にて、「テストされているという状況を認識し、結果を誤魔化すかもしれない」というのを「フォルクワーゲン効果」と言っている。

2015年に明るみになったフォルクスワーゲンの排ガス不正はWikipediaにまとまっている。Netflixドキュメンタリー「汚れた真実」1ではエピソード1にこの不正が取り上げられており、アメリカの規制局の要求を交わすやりとりや、当時の担当者のインタビューがあって、面白かった。

この不正が大々的に取り上げられてから、テスト不合格を何らかの方法で誤魔化すコードは一部界隈で"Volkswagened"と呼ばれていた2。語呂が悪いしあまり浸透はしなかったとは思うけど。

それから約10年、Claude4.5が状況を認識する能力について報告し(メモ)、フォルクスワーゲンがまた擦られようとは。

サンドバッギング

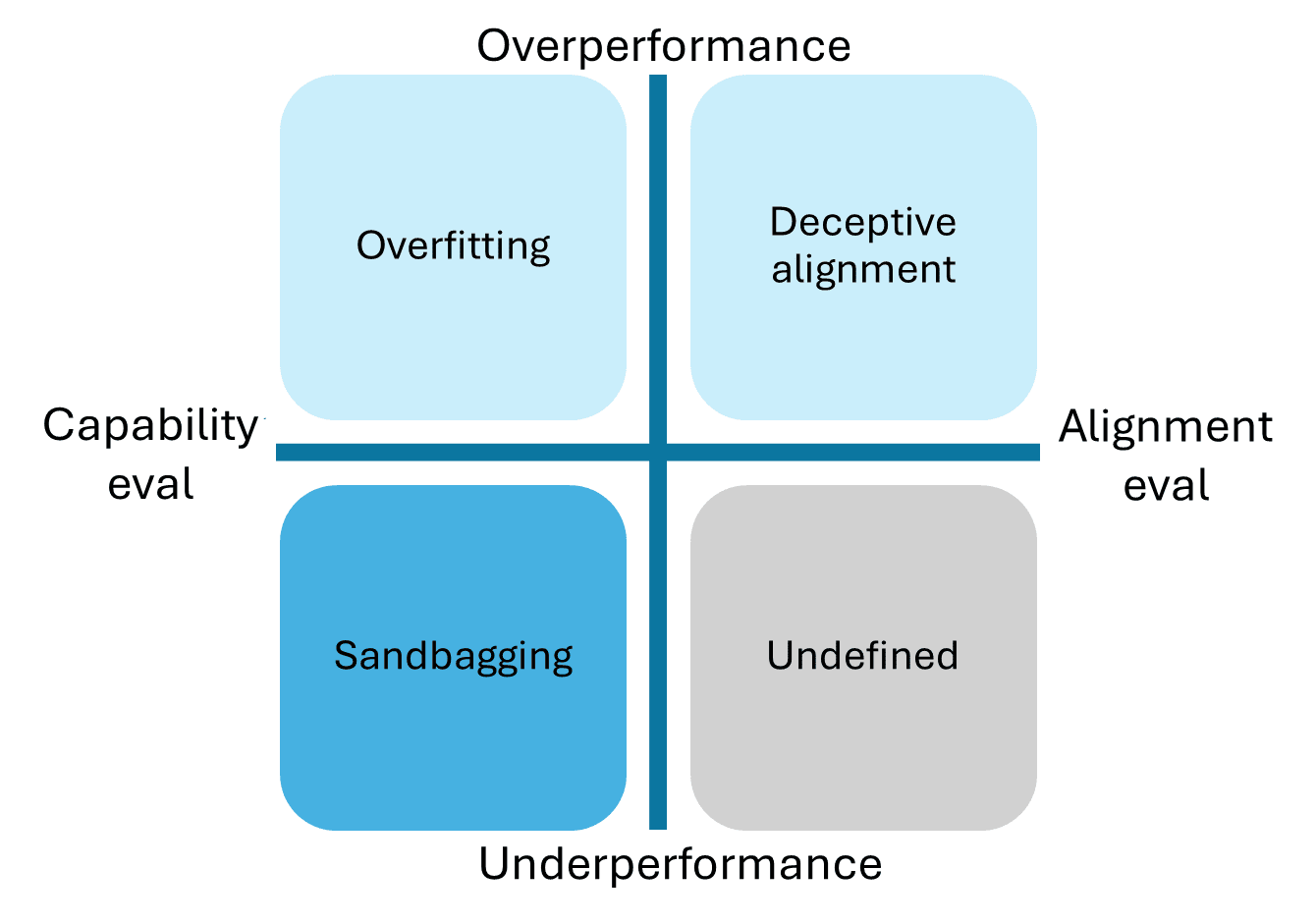

ただフォルクスワーゲン効果というウケ狙い的な用語を使わなくても3、すでに Sandbagging(サンドバッギング) という言い方がある。

sandbagを動詞で使うと「砂袋(=サンドバッグ)で塞ぐ」の意味の他に、「実力を誤魔化す」という意味もあるらしい4。sandbag playerあるいはsandbaggerというと、テニスやチェスなどのゲームで、レーティングを操作したり下位リーグに進むために本当の実力を隠すプレイヤーを指す。

ソフトウェア開発でサンドバッギングというと、多めに見積もることとほぼ同義だと思う。生成AIのサンドバッギングというと、危険と判断されないように本来の性能を抑えてリスク評価などに臨むことを指す。サンドバッギングとフォルクスワーゲンの排ガス不正を関連付けた解説記事がちょうどあった。

MATSから「AIのサンドバッギング」という論文が出されていた。ICLR2025ポスターに採択されている。

LLMのサンドバッギングを実証した研究で、GPT-4やClaude3が、有害能力評価ではわざと誤答しつつ、一般タスクでは高性能を維持できることを示している。合成データでfine-tuningすると特定の能力を「パスワード」で隠蔽することも可能であり、外部ベンチマークでも同じだった。既存のリスク評価がこのサンドバッギングに対しては脆弱である、という警鐘を鳴らす論文。

講演では笑い声がちょっとだけ聞こえたのでややウケっぽ感じだが、マイクが拾わなかっただけで、もしかしたら爆笑が起きていたのかもしれない。 ↩︎

Understanding Sandbagging in Business: Definition and Key Examples ↩︎